티스토리 뷰

▶딥러닝의 이해

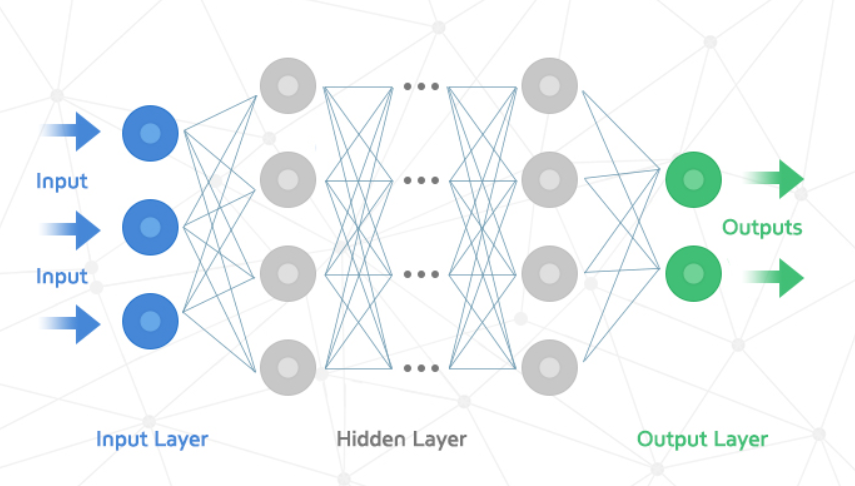

딥러닝은 인공 신경망(Artificial Neural Network)의 한 종류입니다.

그러면 먼저 인공 신경망에 대해 알아봐야겠습니다.

인공신경망은 인간의 두뇌를 구성하는 신경세포 즉, 뉴런(Neuron)의 형태 및 동작 원리를 모방하여 만든 모델입니다.

수학적으로 보면 입력은 가중치(W)와 곱해져 출력층에 연결되고, 출력층은 입력층으로 부터 들어오는 신호를 모두 더해서 내보내는 형태를 나타내고 있습니다.

▷퍼셉트론(Perceptron)

퍼셉트론은 신경망(딥러닝)의 기원이 되는 알고리즘입니다.

퍼셉트론은 다수의 신호를 입력으로 받아 하나의 신호를 출력합니다.

x1과 x2는 입력 신호, y는 출력 신호, w1과 w2는 가중치를 뜻합니다.

여기서 가중치는 각 신호가 결과에 주는 영향력을 조절하는 요소로 작용합니다.

즉, 가중치가 클수록 해당 신호가 그만큼 더 중요함을 뜻합니다.

▷비용 함수(Cost Function)

비용 함수는 예측값과 실제값의 차이 즉 오차를 측정하는 방법입니다.

따라서 신경망의 오차가 크면 비용 함수의 값도 크고, 신경망의 오차가 작으면 비용 함수도 작은 값을 갖습니다.

다시 말해서 우리는 비용 함수가 최소값을 갖는 포인트를 찾아야 합니다.

이말은 미분 가능해야 한다는 말과 같습니다.(MSE: 미분가능, MAE/MAPE: 미분불가능)

주로 분류(Classification) 문제에서는 cross entropy, 분류(Regression) 문제에서는 MSE를 사용합니다.

① 회귀 - MSE

② 분류 - Cross entropy

예측값과 실제값의 차이가 적다면, 가중치를 유지하는 방향으로!

예측값과 실제값의 차이가 크다면, 가중치를 많이 업데이트 하는 방향으로!

▷경사 하강법(Gradient Desent Search)

경사 하강법은 함수의 최소값을 찾는 문제에서 활용됩니다.

정확히 말하자면 최적(optimal)해를 찾는 방법입니다.

즉, 최소값에 최대한 근사시키는 것입니다.

위 함수는 가중치에 따른 비용을 함수로 나타낸 것입니다.

조금조금씩 찾아가게 되는데 이전보다 cost가 적으면 가중치를 업데이트하는 방식입니다.

※ 학습률(learning rate)

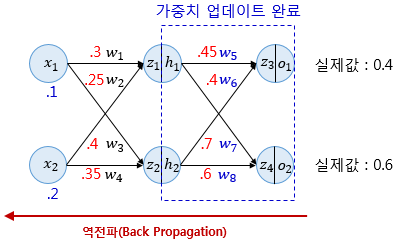

▷역전파(Back-propagation) 알고리즘

역전파 알고리즘은 틀린 예측을 바로잡기 위해 파라미터를 순차적으로 수정해 나가는 학습 알고리즘입니다.

cost를 줄이기 위해서는 가중치를 조절해야 합니다.

이 가중치를 layer-wise하게 가중치를 업데이트 하기 위한 방법입니다.

여기까지 본격적으로 공부하기 전 딥러닝에 대해 이해해 보았습니다 :)

'빅데이터 인공지능 > 딥러닝' 카테고리의 다른 글

| [딥러닝] 역전파(Backpropagation) - 경사하강법 & 활성화 함수 (0) | 2022.09.12 |

|---|---|

| [딥러닝] 파이토치(PyTorch)로 모델 구현 실습🎯- MNIST 손글씨 데이터셋 (2) | 2022.09.03 |

| [딥러닝] 로지스틱 회귀(Logistic Regression) 개념부터 실습까지 (0) | 2022.09.03 |

| [딥러닝] 다중선형회귀(Multi Linear Regression) (0) | 2022.08.30 |

| [딥러닝] 선형 회귀(Linear Regression) (0) | 2022.08.29 |

- Total

- Today

- Yesterday

- Python

- 인프런

- react

- 스타일 컴포넌트 styled-components

- 리액트 훅

- 타입스크립트

- 리액트

- CSS

- JSP

- 데이터분석

- 프론트엔드

- next.js

- 디프만

- rtl

- 프론트엔드 기초

- frontend

- testing

- 자바스크립트

- TypeScript

- styled-components

- 자바

- 딥러닝

- react-query

- HTML

- jest

- 프로젝트 회고

- 머신러닝

- 프론트엔드 공부

- 파이썬

- 자바스크립트 기초

| 일 | 월 | 화 | 수 | 목 | 금 | 토 |

|---|---|---|---|---|---|---|

| 1 | 2 | 3 | 4 | 5 | ||

| 6 | 7 | 8 | 9 | 10 | 11 | 12 |

| 13 | 14 | 15 | 16 | 17 | 18 | 19 |

| 20 | 21 | 22 | 23 | 24 | 25 | 26 |

| 27 | 28 | 29 | 30 |